Apps til deepfake-porno uden samtykke dukker op i App Store – og det er et problem

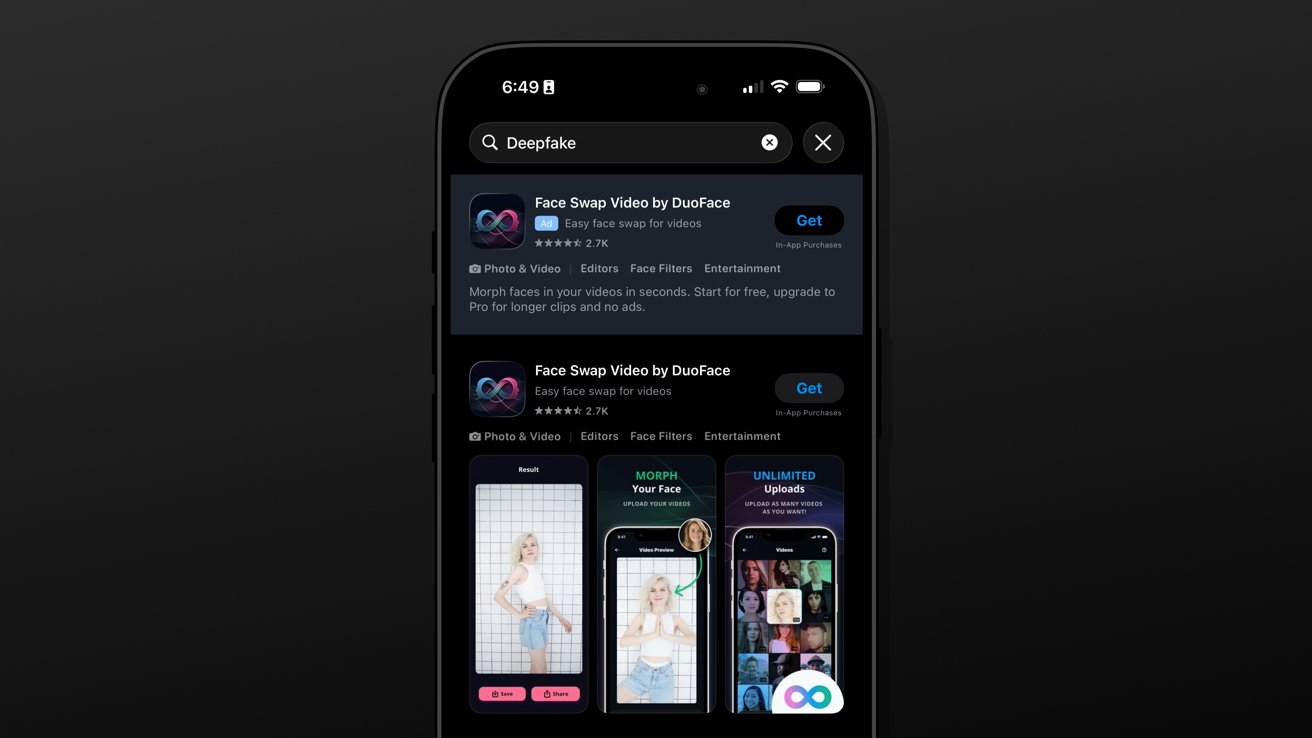

Det er muligt for brugere at finde apps i App Store, der markedsfører funktioner til at skabe deepfakes af personer uden deres viden eller samtykke. Ifølge beskrivelsen kan man i praksis “bare søge” i App Store for at finde den type værktøjer.

Det er vigtigt, fordi distributionen og tilgængeligheden i en officiel platform sænker friktionen markant. Når en app kan nå brugeren via en simpel søgning, bliver misbrug lettere, hurtigere og mere skalerbart.

Sådan fremstår problemet i praksis

Pointen er ikke, at teknologien eksisterer – den gør den. Pointen er, at apps kan reklamere i App Store og samtidig gøre det nemt at skabe ikke-samtykkebaserede deepfakes af personer, der ikke ved, de bliver brugt som “materiale”.

Det understreges også direkte, at Apples App Review i den situation ikke leverer den beskyttelse, man normalt forventer af platformens kontrolmekanismer.

Hvorfor App Store-konteksten gør det værre

Når en app ligger på en officiel markedsplads, oplever mange brugere den som implicit godkendt. Det kan skabe en falsk tryghed omkring, hvad appen kan bruges til, og hvor grænserne går.

Samtidig betyder synlighed via søgning og annoncering, at apps kan ramme et langt bredere publikum end værktøjer, der kun findes via uofficielle kanaler.

Min vurdering

At apps, der muliggør ikke-samtykkebaserede sexvideo-deepfakes, kan findes så let via App Store-søgning, er en alvorlig platformskæde-fejl. Her er det ikke nok med reaktive fjernelser eller minimale retningslinjer i baggrunden – selve tilgængeligheden er det centrale problem.

Hvis App Store skal være et sted, hvor brugere kan hente software med en forventning om grundlæggende ansvarlig screening, så er denne type annoncering og synlighed et signal om, at håndhævelsen halter på et område med åbenlyst skadepotentiale.